Человеческий мозг, по расчетам нейрофизиологов из института Салка, может вместить в себя примерно в 10 раз больше информации, чем считалось раньше, – несколько петабайт данных, чего должно хватить, чтобы вместить почти весь текущий контент интернета, говорится в статье, опубликованной в журнале eLife.

"Это настоящая бомба для нейрофизиологии. Мы нашли ключ к пониманию того, как работают нейроны гиппокампа, центра памяти, того, как им удается сочетать низкий уровень энергопотребления с высокой производительностью. По самым консервативным оценкам, емкость нашей памяти примерно в 10 раз больше, чем мы считали ранее, и ее объем составляет примерно петабайт, что сопоставимо с размерами всей глобальной паутины", — заявил Терри Седжновски (Terry Sejnowski) из Института Салка в Ла-Хойе (США).

Как объясняет Седжновски, сегодня ученые считают, что наши воспоминания содержатся в обособленной части мозга, которую нейрофизиологи называют гиппокампом. Память в нем хранится как в виде электрических импульсов, передаваемых от одного нейрона к другому, так и в виде химических сигналов, которыми нервные клетки обмениваются друг с другом.

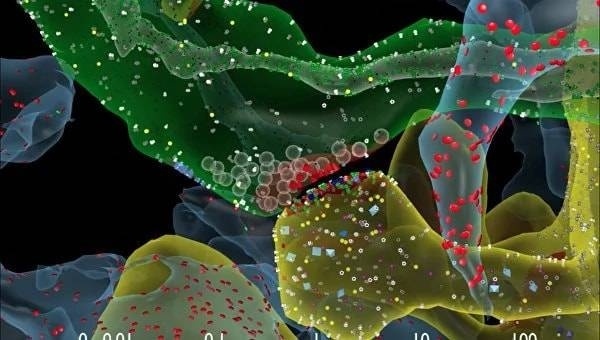

Авторы статьи решили выяснить, как происходят эти процессы, создав полноценную компьютерную модель кусочка гиппокампа размером с одну кровеносную клетку. Симуляция работы даже такой небольшой части мозга, как признают Седжновски и его коллеги, оказалась крайне сложной вычислительной задачей из-за огромного числа соединений между нервными клетками.

Наблюдая за работой синапсов – нервных окончаний – в этой модели, нейрофизиологи заметили нечто крайне необычное. Оказалось, что ряд нервных клеток был связан с одними и теми же "соседями" не одним, а несколькими синапсами с примерно одинаковыми размерами и объемом, что означает, что они передают в нее две копии одного и того же сигнала.

С другой стороны, синапсы, связывающие нейрон с другими клетками, обладали иными размерами, что позволило авторам статьи определить "емкость" единичного нейрона, подсчитав типичное число синапсов разных размеров на каждой нервной клетке в гиппокампе.

Как оказалось, нейроны содержат в себе неожиданно много синапсов разных размеров – 26 типов нервных окончаний, каждый из которых отличался по объему от ближайших к нему по размерам синапсов ровно на 8,3%. Подобная цифра означает в переводе на язык вычислительных устройств, что каждый нейрон может хранить в себе примерно 4,7 бита информации (26 = 2^4,7).

Как это все работает? Секрет заключается в том, что синапсы передают информацию не гарантированно, а с некоторым шансом, который ученые оценивают примерно в 60 процентов.

Надежность доставки данных обеспечивается многократной передачей сигналов и особой системой "автокалибровки" синапсов – их размеры каждые две минуты меняются в большую или меньшую сторону в зависимости от запросов из других областей мозга и получаемых ими сигналов.

Благодаря столь неожиданно большому значению гиппокамп крыс, и, по всей видимости, человека, способен хранить в себе на порядок больше информации, чем считали ученые ранее, – около 5-20 петабайт данных, что сопоставимо с емкостью всей глобальной сети.

Подобные результаты, как отмечает Седжновски, упрочняют статус мозга как самого эффективного вычислительного устройства – потребляя всего 20 ватт энергии, наша нервная система оперирует массивами данных, недоступными для современных суперкомпьютеров.

Это открытие, как надеются авторы статьи, должно вдохновить ученых на попытку воспроизвести эти свойства мозга в сверхэффективных вычислительных приборах.